Les IA génératives sont différentes des IA traditionnelles, qui sont conçues pour effectuer des tâches spécifiques et prédéfinies, telles que la reconnaissance vocale ou la traduction de langues.

Les IA génératives, en revanche, sont capables de produire du contenu « original » (par original est entendu par produire de nouveaux contenus similaires ou proches aux données d'origine ! ), ce qui les rend utiles dans un large éventail d'applications, telles que la génération de contenu - texte, audio, vidéo, image, modèle 3D - pour les médias sociaux, la création de personnages virtuels pour les jeux vidéo, et la génération de musique.

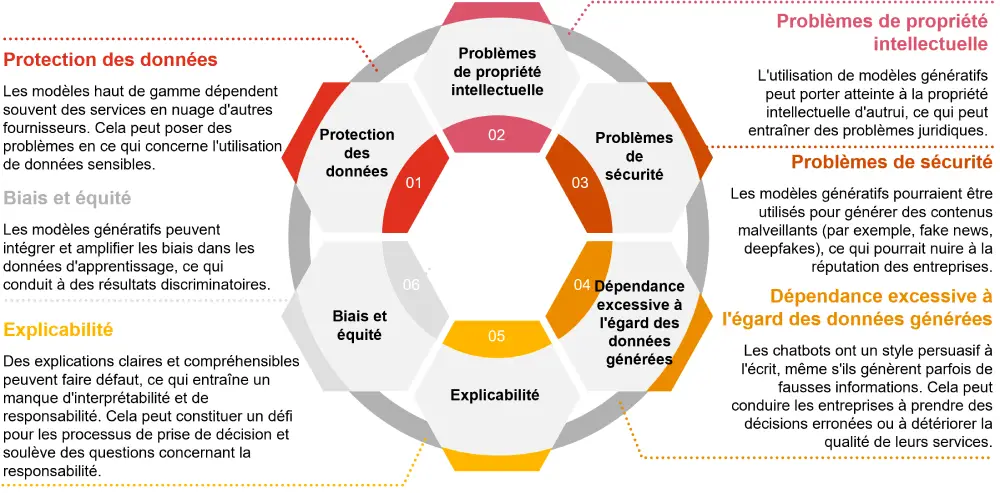

Cependant, les IA génératives peuvent également présenter des risques potentiels pour les entreprises et utilisateurs.

L'utilisation des IA génératives pour les entreprises en Europe

Risques liés à l'utilisation des IA génératives en Europe à considérer :

- Réglementation en évolution :

Les lois encadrant directement les technologies de l'IA générative sont en cours d'élaboration en Europe pour résoudre des problématiques telles que les droits d'auteur des œuvres utilisées par ces IA. - Risques d'hallucinations :

Les IA génératives peuvent parfois produire des contenus erronés présentés comme exacts, ce qui peut entraîner des risques, notamment dans le domaine du commerce en ligne. - Défis juridiques :

L'utilisation de l'IA générative soulève des défis juridiques majeurs, notamment en ce qui concerne la propriété du contenu généré et les droits d'auteur, nécessitant une gestion prudente de ces aspects. - Réflexes juridiques :

Avant d'utiliser une IA générative, il est essentiel de cartographier les risques, de garantir la transparence, de prévoir des mécanismes pour l'exercice des droits des personnes concernées et de s'assurer que le contenu généré respecte les droits de tiers. - Recommandations éthiques :

Des recommandations éthiques sont également proposées pour encadrer l'utilisation des systèmes d'IA générative, notamment en matière de protection des données, de droits d'auteur et d'impact environnemental.

Il est important pour les entreprises en Europe de se conformer aux réglementations en vigueur, de prendre des mesures pour prévenir les risques liés à ces technologies et d'être conscients des implications juridiques et éthiques associées à leur utilisation.

> IA génératives et confidentialité des données des entreprises. Village-Justice le 09-2023

> IA générative : Le guide dédié aux responsables marketing - Rapport du Capgemini Research Institute

Vous souhaitez déployer un système d’intelligence artificielle générative au sein de votre organisme mais vous vous interrogez sur le cadre à respecter ? La CNIL publie des premières réponses pour un déploiement responsable et respectueux de la protection des données.

> Comment déployer une IA générative ? La CNIL apporte de premières précisions - Juillet 2024

IA générative : Un risque pour la sécurité informatique des PME ?

Des chercheurs ont découvert que le modèle d'IA GPT-4 d'OpenAI est capable de pirater des sites web et de voler des informations dans des bases de données en ligne sans aide humaine

" Des informaticiens affiliés à l'université de l'Illinois Urbana-Champaign (UIUC) l'ont démontré en utilisant plusieurs grands modèles de langage (LLM) pour compromettre des sites web vulnérables sans intervention humaine. "

IA generative - les différentes utilisations

Pour les utilisateurs, l'usage des IA génératives est aussi à prendre avec des précautions :

. L’exemple des Droits d'auteur :

Les IA génératives sont formées avec d'immenses quantités de matériel protégé par des droits d'auteur tels que des écrits, des images et bien plus encore. Elles exploitent ensuite indirectement ces œuvres pour produire des réponses aux requêtes de leurs utilisateurs, qui peuvent alors diffuser des contenus potentiellement litigieux.

. Une utilisation croissante :

Des études montrent que les solutions d'IA générative représentent l'une des principales préoccupations des responsables de la sécurité informatique depuis le deuxième trimestre 2023. L'essor rapide de cette technologie expose davantage d'utilisateurs aux risques associés.

> (vidéo) ChatGPT vient de devenir dangereux _Underscore

. La Propriété intellectuelle :

L'utilisation de données libres d'accès pour former les IA génératives pose des questions juridiques, car elle peut impliquer l'exploitation non autorisée de données sensibles ou confidentielles provenant de diverses sources sans le consentement des utilisateurs.

Le problème majeur est le risque de fuite d’informations sensibles, lors de l'apprentissage initial et lors de la création du contenu généré.

> Intelligences artificielles génératives : la guerre des données est déclarée - Vilage-Justice sept. 2023

> [Dossier IA générative] - Quelles régulations pour la conception des IA génératives ? CNIL

Les utilisateurs doivent être conscients des risques potentiels associés à l'utilisation des IA génératives et doivent prendre des mesures pour les utiliser de manière responsable, par exemple en ne partageant pas de données personnelles sensibles avec ces systèmes.

" Si vous demandez par exemple à ChatGPT de résumer un contrat ou un document confidentiel, d’analyser un code informatique propriétaire, de corriger un texte ou une chanson dont vous êtes l’auteur, toutes ces données sont ingurgitées de facto par le robot et peuvent potentiellement être divulguées à d’autres utilisateurs.

Le géant coréen Samsung a notamment interdit l’utilisation de ChatGPT, Bard, ou encore Bing à ses employés suite à plusieurs incidents."

> Plateformes d’IA génératives : quels sont les risques en matière de sécurité et de confidentialité ?

. Autres risques :

La qualité des contenus générés (problèmes de fiabilité et d'authenticité), propagation de fausses informations, manipulations des informations, deepfakes, augmentation d'acte cybercriminel (phishing, chantage, malwares sophistiqués, exploitation de failles de sécurité, automatisation d'attaques massives...)

IA generative - les différents problèmes

ajout le 21-07-2025

Pensez à votre vie privée avant de partager vos données personnelles avec l'IA.

À l’ère de l’intelligence artificielle, les assistants, chatbots et agents IA demandent de plus en plus d’accès à nos données personnelles sous prétexte d’améliorer leur fonctionnement. Cependant, accorder ces autorisations peut poser de sérieux risques pour la vie privée et la sécurité.

> Pensez à votre vie privée avant de partager vos données personnelles avec l’IA - ai-explorer, juillet 2025

Les IA generatives, moteurs de la manipulation et de la désinformation

Comme dit plus haut, ces IA generatives soulèvent des problèmes juridiques et sécuritaires.

Mais dans le danger des utilisations des IA generatives, la désinformation et les fausses informations sont très souvent évoquées, et à juste titre.

Si les médias traditionnels sont encore essentiellement utilisés par une majorité de personnes, les médias alternatifs occupent une place de plus plus en importantes.

La vague de fond inquiétante est que de plus en plus de personnes ne cherchent d'informations précises mais des informations qui confirment leurs idées (souvent fondées sur une méfiance généralisée des politiques et des médias).

Nos sociétés divisées, et de plus en plus polarisées, sont un terreau idéal pour la propagation de la désinformation (rumeurs, fausses informations, théories idéologiques), semer la confusion, influencer l'opinion public, susciter la défiance, créer du doute, discréditer des informations factuelles...

Les IA generatives accélèrent le phénomène.

Dans un temps pas si lointain, il fallait maîtriser des outils et logiciels nécessitant du temps et de l'argent.

Aujourd'hui en quelques minutes et 10aines d'euro, il est extrêmement facile de produire n’importe quels types de contenus : textes (chatGPT et autres), images (Midjourney, Dall-e...), vidéos (voir les démonstrations avec Sora).

> L’IA générative, un acteur majeur dans une société de la désinformation ? - TheConversion mars 2024

IA et Société

Quels régimes de régulation des données pour entraîner les IA ?

Université Paris Dauphine - 20.11.2023

Particulièrement instructif ! :)

En savoir + :

. Systèmes d’intelligence artificielle générative : enjeux d’éthique. Avis 7 du CNPEN - 30 juin 2023 (PDF)

. La protection des données personnelles dans le tourbillon algorithmique de l’IA générative - Marketing Client

. IA générative : pourquoi nous avons besoin d’une IA de confiance - Usbek et Rica mars 2024

Comme on vient de le voir, l’utilisation d’IA génératives américaines en Europe soulève plusieurs enjeux juridiques, éthiques et techniques, notamment en raison des différences réglementaires entre les États-Unis et l’Union européenne.

Les principales précautions à prendre

1. Conformité au RGPD (Règlement Général sur la Protection des Données)

- Protection des données personnelles : Les IA génératives peuvent traiter des données personnelles (noms, adresses, etc.). Assurez-vous que leur utilisation respecte le RGPD, notamment en obtenant le consentement des personnes concernées et en garantissant leur droit à l’oubli.

- Transfert de données hors UE : Les données traitées par des IA américaines peuvent être transférées vers les États-Unis, où la protection des données est moins stricte. Utilisez des clauses contractuelles types (SCC) ou des mécanismes comme le Privacy Shield (remplacé par le Data Privacy Framework) pour encadrer ces transferts.

- Minimisation des données : Limitez la collecte et le traitement aux données strictement nécessaires.

2. Respect du droit d’auteur et de la propriété intellectuelle

- Contenu généré : Vérifiez que l’IA ne reproduit pas du contenu protégé par des droits d’auteur sans autorisation. En Europe, la directive sur le droit d’auteur (2019/790) impose des règles strictes sur l’utilisation de contenus protégés.

- Transparence : Informez les utilisateurs si le contenu est généré par une IA, surtout dans un contexte professionnel ou public.

3. Transparence et explicabilité

- Obligation d’information : Selon l’AI Act, les systèmes d’IA doivent être transparents sur leur fonctionnement et leurs limites, surtout pour les usages à haut risque (santé, justice, etc.).

- Traçabilité : Documentez les sources et les processus utilisés par l’IA pour générer du contenu, afin de pouvoir expliquer les décisions ou résultats.

4. Biais et discrimination

- Évaluation des risques : Les IA peuvent reproduire des biais présents dans leurs données d’entraînement. Testez les outils pour détecter d’éventuels biais discriminatoires (genre, origine ethnique, etc.).

- Diversité des données : Privilégiez des modèles entraînés sur des jeux de données diversifiés et représentatifs.

5. Sécurité et cybersécurité

- Protection contre les fuites : Les données sensibles (médicales, financières) ne doivent pas être exposées via des IA externes. Utilisez des solutions locales ou chiffrées si nécessaire.

- Audit des fournisseurs : Vérifiez que le fournisseur américain respecte les normes européennes de sécurité (ISO 27001, etc.).

6. Responsabilité juridique

- Clauses contractuelles : Précisez dans les contrats qui est responsable en cas de litige (fournisseur, utilisateur, etc.).

- Assurance : Souscrivez une assurance couvrant les risques liés à l’utilisation d’IA, notamment en cas de violation de données ou de contentieux.

7. Usage professionnel et éthique

- Validation humaine : Ne vous fiez pas uniquement à l’IA pour des décisions critiques (recrutement, diagnostics médicaux, etc.).

- Éthique : Respectez les lignes directrices européennes sur l’IA de confiance (ex : recommandations de la Commission européenne).

8. Veille réglementaire

- Mises à jour légales : Le cadre réglementaire européen évolue rapidement (AI Act, ePrivacy, etc.). Restez informé des nouvelles obligations.

- Autorités compétentes : En cas de doute, consultez la CNIL (France) ou l’EDPB (autorité européenne de protection des données).

Exemples concrets

Si vous utilisez une IA Generative pour générer du contenu marketing :

- Anonymisez les données clients.

- Vérifiez que le contenu ne viole pas de droits d’auteur.

- Mentionnez clairement l’origine IA du contenu.

- S’assurer que le fournisseur de l’IA respecte le Data Privacy Framework pour les transferts de données vers les États-Unis.

Pour une aide au diagnostic médical :

- Obtenir le consentement explicite des patients pour le traitement de leurs données médicales.

- Stocker les données sur des serveurs européens ou utiliser un chiffrement robuste avant tout transfert.

- Toujours faire valider les diagnostics par un médecin.

Si l’IA est classée comme "à haut risque", respecter les obligations de traçabilité et d’audit imposées par la réglementation européenne.

Pour les corrections de devoirs :

- Vérifier que l’IA ne pénalise pas certains styles d’écriture ou origines culturelles.

- Ne pas transmettre les noms des élèves à l’IA.

- Expliquer aux élèves comment l’IA fonctionne pour éviter une dépendance excessive.

Pour de la Génération de code

- S’assurer que le code généré ne viole pas de licences open source ou de brevets.

- Vérifier le code pour éviter les vulnérabilités (ex : injections SQL).

- Documenter l’utilisation de l’IA dans le processus de développement.

Pour un Service client : Chatbots

- RGPD : Ne pas enregistrer les conversations sans consentement.

- Permettre aux clients de demander une explication si la réponse de l’IA semble incorrecte.

- Adapter l’IA aux spécificités linguistiques et culturelles locales (ex : français de France vs. français de Belgique).

> CAS CONCRET : Mise en place un chatbot de service client

Pour des activités : Génération d’images

- Droit d’auteur : Éviter de reproduire le style d’artistes existants sans autorisation.

- Mentionner l’utilisation de l’IA dans la description de l’œuvre.

- Modifier suffisamment les images générées pour éviter les plaintes pour plagiat.

En lien avec l’article :

. Chatbots et confidentialité

. Les fausses nouvelles générées par l’IA

. Des magazines générés par des IA

. L'interdiction du scoring social basé sur l'IA : renforcer la réglementation de l'UE

. L'impact de l'IA sur la recherche en ligne et le SEO

. La vague de l'IA : impact, crainte et adaptation

. L'avenir des sites web alimentés par l'IA